Farfalle jämfört med Perplexica

Jämförelse av två självhuserade AI-sökmotorer

Underbar mat är också en njutning för ögonen. Men i detta inlägg jämför vi två AI-baserade söksystem, Farfalle och Perplexica.

Övrigt, denna form av pasta kallas också “farfalle”.

Men här jämför jag enbart hur dessa två system beter sig. Inte pastaförmerna.

OK. Koncentrera!

Se även Installation och konfiguration av Perplexica – med Ollama och Installera och konfigurera Ollama.

Svarsmotorn som denna artikel kallar Perplexica levereras nu upstream som Vane; Vane (Perplexica 2.0) Snabbstart med Ollama och llama.cpp är platsen att leta efter aktuella Docker-images, SearxNG-koppling och tidsaxeln för namnbytet.

Perplexica

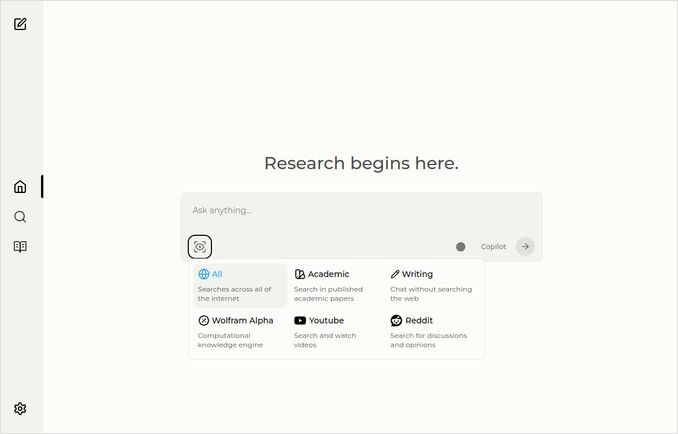

Här är startsidan med ett rullgardinsmeny för att välja källor.

- Perplexica är implementerat i

- TypeScript och React.Js (UI)

- TypeScript och Express.Js (Backend)

- inkluderar även konfiguration för metasökmotorn SearxNG

- Har ett Copilot-läge

- Har möjlighet att använda vilken Ollama-hostad LLM som helst som chatt- eller inbäddningsmodell

- Har tre små interna inbäddningsmodeller

Farfalle

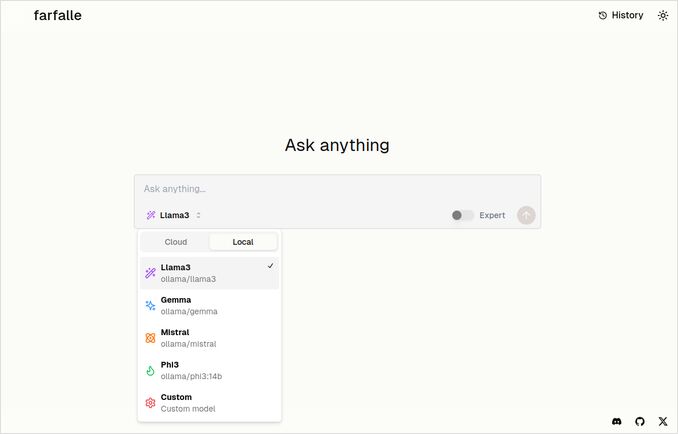

- Farfalle är implementerat i

- TypeScript och React.Js (UI)

- Python Fastapi (Backend)

- inkluderar även referens till metasökmotorn SearxNG. Inte mycket konfiguration för detta, ganska standard Docker-image.

- Har ett Expert-läge som ska förbereda flera förfrågningar från den ursprungliga och kombinera svaren. Men detta fungerade inte i våra tester.

- Har möjlighet att använda fyra Ollama-hostade LLM:er som chattmodell (llama3, mistral, gemma, phi3). Det är en bra uppsättning alternativ, men jag hade hellre sett att det är mer flexibelt och tillåter användning av vilken modell som helst som Ollama serverar.

- Inga alternativ för inbäddningsmodell

Jämförelse gjord av Perplexica och Farfalle själva

Jag körde samma förfrågan: Jämför Farfalle och Perplexica baserat på robusthet, community, support och LLM-stöd.

Både Perplexica och Farfalle använde modellen llama3 som värdes lokalt på ollama. Modellens fullständiga namn är llama3 8b q4.

Tro inte 100% på vad svaren säger, titta bara på textlängd, struktur och total svarskvalitet.

Jag skulle tro på ungefär 70%…

Perplexicas jämförelsesvar

Jämförelse av Farfalle och Perplexica

Robusthet

Farfalle: 8/10 - Farfalle är en populär AI-sökmotor känd för sin tillförlitlighet och förmåga att hantera komplexa förfrågningar. Den har en stark grund i naturligt språkteknik (NLP) och maskininlärning (ML). Även om den kanske inte är perfekt, är Farfalle’s robusthet väl etablerad.

Perplexica: 9/10 - Perplexica bygger på Meta AI:s Phi-3-modell, som är utformad för robusthet. Den har testats för att ge korrekta svar även när den möter tvetydiga eller otydliga förfrågningar. Dess förmåga att parafrasera frågor och anpassa sig till olika sammanhang gör den till en robust sökmotor.

Community

Farfalle: 7/10 - Farfalle har ett dedikerat community av användare som uppskattar dess funktioner. Även om den kanske inte har samma grad av adoption som Perplexica, är Farfalle’s användarbas ändå betydande.

Perplexica: 8.5/10 - Perplexica har fått bred erkännelse för sitt innovativa tillvägagångssätt till sökmotorer. Dess community växer snabbt, med många användare som uppskattar dess förmåga att ge korrekta och relevanta resultat.

Support

Farfalle: 6.5/10 - Farfalle ger grundläggande support genom FAQ, dokumentation och forum. Även om det inte är lika omfattande som Perplexica’s support, är Farfalle’s användarbas generellt självgående.

Perplexica: 9/10 - Perplexica erbjuder omfattande supportresurser, inklusive detaljerad dokumentation, FAQ och community-forum. Dess utvecklare är aktivt engagerade med communityt, vilket säkerställer att användare får snabb och effektiv hjälp.

LLM:er som stöds

Farfalle: Nej - Farfalle är en självständig AI-sökmotor som inte är beroende av stora språkmodeller (LLM) för sina funktioner.

Perplexica: Ja - Perplexica bygger på Meta AI:s Phi-3-modell, som är en LLM. Detta tillåter Perplexica att utnyttja kraften i djupinlärning för mer korrekta och relevanta resultat.

Totalpoäng: Farfalle: 22/30, Perplexica: 34.5/40

Baserat på dessa kriterier verkar Perplexica ha en liten fördel över Farfalle när det gäller robusthet, community-support och LLM-integration. Men båda sökmotorerna har sina styrkor, och valet beror i slutändan på dina specifika behov och preferenser.

Rekommendation: Om du letar efter en tillförlitlig AI-sökmotor med starka NLP-funktioner, kan Perplexica vara det bättre valet. Om du föredrar ett mer rakt fram, enklare tillvägagångssätt till sökning, kan Farfalle fortfarande ge utmärkta resultat.

Farfalle jämförelsesvar

Jämförelse av Farfalle och Perplexica

Farfalle och Perplexica är två AI-drivna sökmotorer som fått uppmärksamhet nyligen. Här är en jämförelse av dessa två projekt baserat på robusthet, community, support och LLM-stöd (Large Language Model).

Robusthet

- Farfalle är utformat för att vara självhyst med lokala eller molnbaserade LLM:er, vilket gör det till ett mer robust alternativ för användare som vill ha kontroll över sin sökmotor.

- Perplexica, å andra sidan, är ett öppen källkods-alternativ till Perplexity AI och förbättras kontinuerligt av dess utvecklare.

Community

- Perplexica har ett dedikerat community av utvecklare och användare som bidrar till dess utveckling och ger support.

- Farfalle’s community är mindre, men det har ändå en närvaro på GitHub.

Support

- Perplexica erbjuder regelbundna uppdateringar och förbättringar, samt en Discord-kanal för att diskutera frågor utanför vanlig support.

- Farfalle’s support är begränsad till GitHub-issues och pull requests.

LLM-stöd: Både Farfalle och Perplexica stöder LLM:er. Perplexica använder Ollama, en lokal LLM, medan Farfalle stöder både lokala och molnbaserade LLM:er.

Sammanfattningsvis är Farfalle mer robust tack vare sitt självhysta design, medan Perplexica har ett starkare community och bättre support. Båda projekten stöder LLM:er, men Perplexica använder specifikt Ollama.

Slutsats

Vilken är skillnaden mellan Perplexica och Farfalle?

Svaret:

- Om vi lägger åt sidan några faktiska fel, tror båda systemen att Perplexica är bättre än Farfalle, vilket jag gärna håller med om.

- Jag gillar Farfalle’s UI, även om de är ganska lika.

- Jag gillar idén med Farfalle’s expertläge, även om det inte fungerade i min miljö.

- Jag stötte på 3 buggar när jag körde Farfalle. Perplexica-koden är mer polerad.

- När den väl var konfigurerad, körde Perplexica utan några fel.

- Perplexica tillåter användning av vilken Ollama-hostad modell som helst. Och Farfalle tillåter bara att använda Gemma, Llama3, Mistral och Phi3 (fördefinierade versioner, som är lite föråldrade).

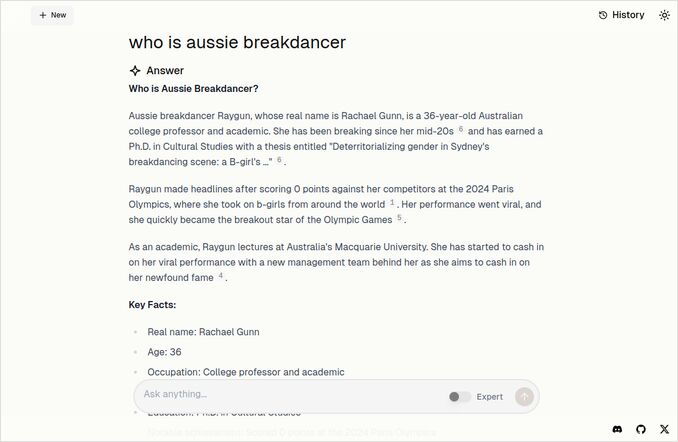

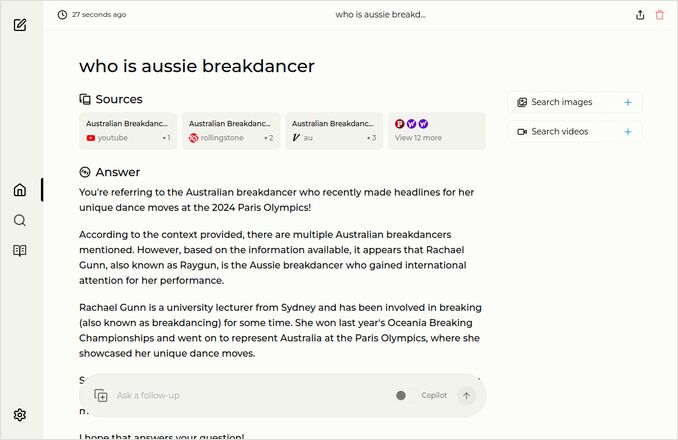

- Jag gillar Farfalle’s svar mer. Titta på Farfalle-bilden nedan. Rakt på sak utan alla de “Enligt den kontext som tillhandahållits”…

Fler exempel

Dessa visar svar på samma fråga om en australisk breakdancer. Du vet, den med doktorandexamen som fick 0 (noll) poäng och troligen fick breakdancing att tas bort från olympiska programmet.

Farfalle-svar

Perplexica-svar

Om du läser upp (eller ner) kommer du till detta sista stycke. Tack för att du har samma intressen som jag. Det är verkligen spännande tider. Ha en bra dag!

Användbara länkar

- Sök vs Djupsök vs Djupforskning

- Test: Hur Ollama använder Intel CPU-prestanda och effektiva kärnor

- Hur Ollama hanterar parallella förfrågningar

- Självhyst Perplexica – med Ollama

- Jämförelse av LLM:s sammanfattend förmåga

- Skriva effektiva prompter för LLM:er

- Testning av logisk fallacy-detektering av nya LLM:er: gemma2, qwen2 och mistral Nemo

- Ollama-fuskblad

- Markdown-fuskblad

- Molnbaserade LLM-leverantörer

- Qwen3 Embedding & Reranker-modeller på Ollama: State-of-the-Art-prestanda