Öppen WebUI: Eget värd LLM-gränssnitt

Egenvärd ChatGPT-alternativ för lokala LLMs

Öppna WebUI är ett kraftfullt, utökligt och funktionstomt självvärddat webbgränssnitt för att interagera med stora språkmodeller.

Egenvärd ChatGPT-alternativ för lokala LLMs

Öppna WebUI är ett kraftfullt, utökligt och funktionstomt självvärddat webbgränssnitt för att interagera med stora språkmodeller.

Snabb LLM-inference med OpenAI API

vLLM är en högflödes- och minneseffektiv inferens- och serveringmotor för stora språkmotorer (LLM) som utvecklats av UC Berkeleys Sky Computing Lab.

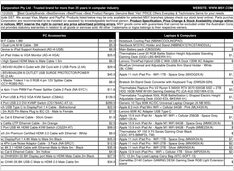

Verkliga AUD-priser från australiska återförsäljare nu

NVIDIA DGX Spark (https://www.glukhov.org/sv/hardware/ai/nvidia-dgx-spark/ “NVIDIA DGX Spark - liten AI-superdator”) (GB10 Grace Blackwell) är nu tillgänglig i Australien (https://www.glukhov.org/sv/hardware/ai/dgx-spark-pricing-in-australia/ “DGX Spark i Australien”) hos större datorhandlare med lokalt lager. Om du har följt globala priser och tillgänglighet för DGX Spark, är du kanske intresserad av att veta att priserna i Australien ligger mellan 6 249 och 7 999 AUD beroende på lagringskonfiguration och återförsäljare.

Teknisk guide för upptäckt av AI-genererat innehåll

AI-genererad innehålls explosion har skapat ett nytt utmaning: att skilja mellan riktigt mänskligt skrivande och “AI slop” - lågkvalitativt, massproducerat syntetiskt text.

Testa Cognee med lokala LLMs - verkliga resultat

Cognee är en Pythonramverk för att bygga kunskapsgrafer från dokument med hjälp av LLMs. Men fungerar det med självvärdbaserade modeller?

Typsäkra LLM-utdata med BAML och Instructor

När du arbetar med stora språkmodeller i produktion är det kritiskt att få strukturerade, typsäkra utdata. Två populära ramverk – BAML och Instructor – använder olika metoder för att lösa detta problem.

Reflektioner kring LLM:er för självvärdd Cognee

Välj den Bästa LLM för Cognee kräver att balansera kvaliteten på grafbygge, hallucinationsfrekvens och hårdvarukonster. Cognee presterar bäst med större, låg-hallucination modeller (32B+) via Ollama men medelstorleksalternativ fungerar för lättare konfigurationer.

Bygg AI-söklägenheter med Python och Ollama

Ollamas Python-bibliotek inkluderar nu inbyggda OLlama web search-funktioner. Med bara några rader kod kan du komplettera dina lokala LLMs med realtidssökningar på webben, vilket minskar hallucinationer och förbättrar noggrannheten.

Välj rätt vektordatabas för din RAG-stack.

Att välja rätt vektordatabas kan avgöra om din RAG-applikation presterar bra eller inte, samt påverka kostnad och skalbarhet. Denna omfattande jämförelse täcker de mest populära alternativen under 2024–2025.

Bygg AI-söklägenheter med Go och Ollama

Ollamas webbsöknings-API låter dig komplettera lokala LLMs med realtidsinformation från webben. Den här guiden visar hur du implementerar webbsökningsfunktioner i Go, från enkla API-anrop till fullständiga sökningsagenter.

Jämför de bästa lokala LLM-värdverktygen 2026. API-mognad, hårdvaruunderstöd, verktygsanrop och verkliga användningsfall.

Köra LLM:er lokalt är nu praktiskt för utvecklare, startups och även enterprise-teams.

Men att välja rätt verktyg – Ollama, vLLM, LM Studio, LocalAI eller andra – beror på dina mål:

Bygg robusta AI/ML-pipelines med Go-mikrotjänster

När AI- och ML-arbetsbelastningar blir alltmer komplexa, har behovet av robusta orkestreringssystem ökat.

Gos enkelhet, prestanda och konkurrensförmåga gör det till ett idealt val för att bygga orkestreringsskiktet i ML-pipelines, även när modellerna själva är skrivna i Python.

Förena text, bilder och ljud i gemensamma inbäddningsutrymmen

Korsmodal inbäddning representerar en genombrottsteknik inom artificiell intelligens, som möjliggör förståelse och resonemang över olika datatyper inom ett gemensamt representationsutrymme.

Implementera företags AI på budgetmaskinvaru med öppna modeller.

Demokratiseringen av AI är här. Med öppna källkodsmodeller som Llama, Mistral och Qwen som nu är jämbördiga med proprietära modeller, kan team bygga kraftfull AI-infrastruktur med konsumenthårdvara – vilket sänker kostnaderna kraftigt samtidigt som man behåller full kontroll över dataprivacy och implementering.

LongRAG, Self-RAG, GraphRAG – nästa generations teknik

Retrieval-Augmented Generation (RAG) har utvecklats långt bortom enkel vektorbaserad likhetssökning. LongRAG, Self-RAG och GraphRAG representerar framkanten av dessa möjligheter.

Accelerera FLUX.1-dev med GGUF-kvantisering

FLUX.1-dev är en kraftfull text-till-bild-modell som producerar imponerande resultat, men dess minneskrav på 24GB+ gör den svår att köra på många system. GGUF-kvantisering av FLUX.1-dev erbjuder en lösning, reducerar minnesanvändningen med cirka 50% samtidigt som bildkvaliteten bibehålls.