比较NVIDIA GPU在AI方面的适用性

人工智能需要消耗大量算力……

目录

在现代世界纷乱的环境中,我在这里比较不同显卡的技术规格,这些显卡适用于AI任务

(深度学习,

目标检测

和大语言模型)。

不过它们都非常昂贵。

这是AI生成的图像。请不要当真…

让我们看看其他选项,只是随便看看

| 显卡型号 | 显存 | 总线宽度 | 内存带宽 | CUDA核心 | Tensor核心 | 功耗(W) |

|---|---|---|---|---|---|---|

| RTX 4060 Ti 16GB | 16 GB | 128-bit | 288 GB/s | 4,352 | 136 | 165 |

| RTX 4070 Ti 16GB | 16 GB | 256-bit | 672 GB/s | 7,680 | 240 | 285 |

| RTX 4080 16GB | 16 GB | 256-bit | 716.8 GB/s | 9,728 | 304 | 320 |

| RTX 4080 Super 16GB | 16 GB | 256-bit | 736 GB/s | 10,240 | 320 | 320 |

| RTX 4090 24GB | 24 GB | 384-bit | 1008 GB/s | 16,384 | 512 | 450 |

| RTX 5060 Ti 16GB | 16 GB | 128-bit | 448 GB/s | 4,608 | 144 | 180 |

| RTX 5070 Ti 16GB | 16 GB | 256-bit | 896 GB/s | 8,960 | 280 | 300 |

| RTX 5080 16GB | 16 GB | 256-bit | 896 GB/s | 10,752 | 336 | ~320 |

| RTX 5090 32GB | 32 GB | 512-bit | 1792 GB/s | 21,760 | 680 | ~450 |

| RTX 2000 Ada | 16 GB | 128-bit | 224 GB/s | 2,816 | 88 | 70 |

| RTX 4000 Ada | 20 GB | 160-bit | 280 GB/s | 6,144 | 192 | 70 |

| RTX 4500 Ada | 24 GB | 192-bit | 432 GB/s | 7,680 | 240 | 210 |

| RTX 5000 Ada | 32 GB | 256-bit | 576 GB/s | 12,800 | 400 | 250 |

| RTX 6000 Ada | 48 GB | 384-bit | 960 GB/s | 18,176 | 568 | 300 |

内存带宽:

- RTX 5090 (1792 GB/s),然后是RTX 4090(1008 GB/s),然后是RTX 6000 Ada (960 GB/s)

Tensor核心:

- RTX 5090 (680),然后是RTX 6000 Ada (568),然后是RTX 4090 (512)

CUDA核心:

- RTX 5090 (21,760),然后是RTX 6000 Ada (18,176),然后是RTX 4090 (16,384)

内存:

- RTX 6000 Ada (48 GB),然后是RTX 5090和RTX 5000 Ada (32 GB),然后是RTX 4090 (24GB)

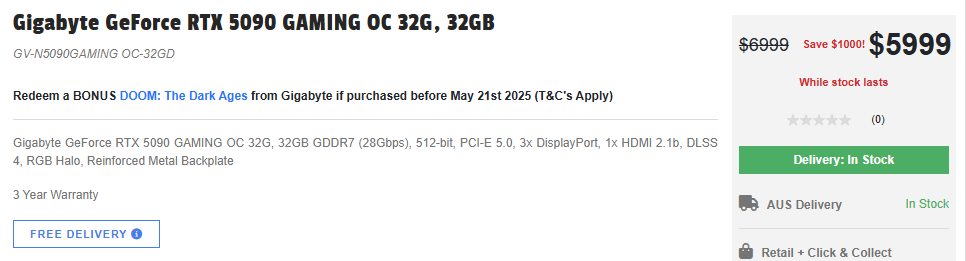

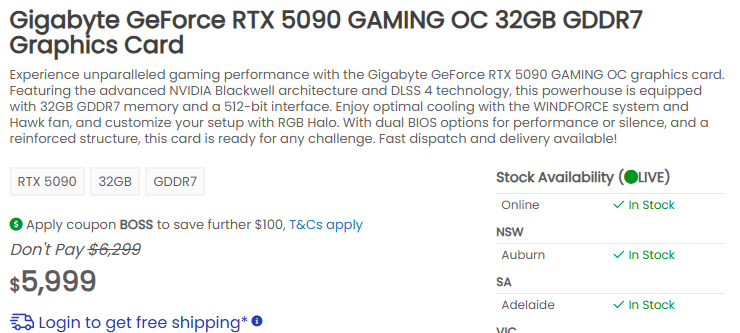

澳大利亚的价格

- RTX 6000 Ada: 12,000 澳元

- RTX 5090: 6,000 澳元

- RTX 5000 Ada: 7,000 澳元

- RTX 4090: 已售罄

最适合消费者的LLM GPU

尽管如此,我认为RTX 5090仍然是机器学习、深度学习、AI甚至LLM的最佳选择:)

实际价格

价格有点高…

而实际RTX 5090的价格比预期高出50%。看看这个!

那是2025年5月15日