Jämförelse av NVidia GPU-lämplighet för AI

AI kräver mycket kraft...

I mitt håll i den moderna världens kaos här är jag jämförande tekniska specifikationer av olika kort som är lämpliga för AI uppgifter (Deep Learning, Objektidentifiering och LLM). De är alla otroligt dyra dock.

För mer om hur val av GPU påverkar LLM-throughput, VRAM-gränser och benchmarkar över olika körningar, se LLM-prestanda: Benchmarkar, halsar och optimering.

Detta är en AI-genererad bild. Ta inte den på allvar…

Låt oss titta på andra alternativ, bara för att kika runt

| Kort | VRAM | Bus Width | Minnesbandbredd | CUDA-kärnor | Tensor-kärnor | Effekt (W) |

|---|---|---|---|---|---|---|

| RTX 4060 Ti 16GB | 16 GB | 128-bit | 288 GB/s | 4,352 | 136 | 165 |

| RTX 4070 Ti 16GB | 16 GB | 256-bit | 672 GB/s | 7,680 | 240 | 285 |

| RTX 4080 16GB | 16 GB | 256-bit | 716,8 GB/s | 9,728 | 304 | 320 |

| RTX 4080 Super 16GB | 16 GB | 256-bit | 736 GB/s | 10,240 | 320 | 320 |

| RTX 4090 24GB | 24 GB | 384-bit | 1008 GB/s | 16,384 | 512 | 450 |

| RTX 5060 Ti 16GB | 16 GB | 128-bit | 448 GB/s | 4,608 | 144 | 180 |

| RTX 5070 Ti 16GB | 16 GB | 256-bit | 896 GB/s | 8,960 | 280 | 300 |

| RTX 5080 16GB | 16 GB | 256-bit | 896 GB/s | 10,752 | 336 | ~320 |

| RTX 5090 32GB | 32 GB | 512-bit | 1792 GB/s | 21,760 | 680 | ~450 |

| RTX 2000 Ada | 16 GB | 128-bit | 224 GB/s | 2,816 | 88 | 70 |

| RTX 4000 Ada | 20 GB | 160-bit | 280 GB/s | 6,144 | 192 | 70 |

| RTX 4500 Ada | 24 GB | 192-bit | 432 GB/s | 7,680 | 240 | 210 |

| RTX 5000 Ada | 32 GB | 256-bit | 576 GB/s | 12,800 | 400 | 250 |

| RTX 6000 Ada | 48 GB | 384-bit | 960 GB/s | 18,176 | 568 | 300 |

Minnesbandbredd:

- RTX 5090 (1792 GB/s), sedan RTX 4090 (1008 GB/s), sedan RTX 6000 Ada (960 GB/s)

Tensor-kärnor:

- RTX 5090 (680), sedan RTX 6000 Ada (568), sedan RTX 4090 (512)

CUDA-kärnor

- RTX 5090 (21,760), sedan RTX 6000 Ada (18,176, sedan RTX 4090 (16,384)

RAM

- RTX 6000 Ada (48 GB), sedan RTX 5090 och RTX 5000 Ada (32 GB), sedan RTX 4090 (24 GB)

Priser i Australien

- RTX 6000 Ada: 12 000 AUD

- RTX 5090: 6 000 AUD

- RTX 5000 Ada: 7 000 AUD

- RTX 4090: utsåld

Bästa konsument-GPU för LLM

Ändå tror jag att RTX 5090 skulle vara den bästa valet för maskininlärning, deep learning, AI och till och med LLM :).

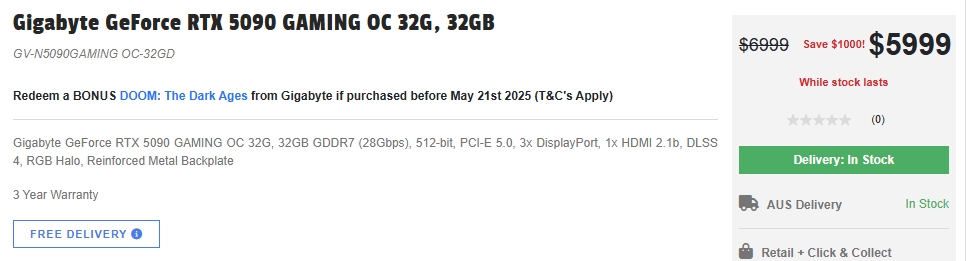

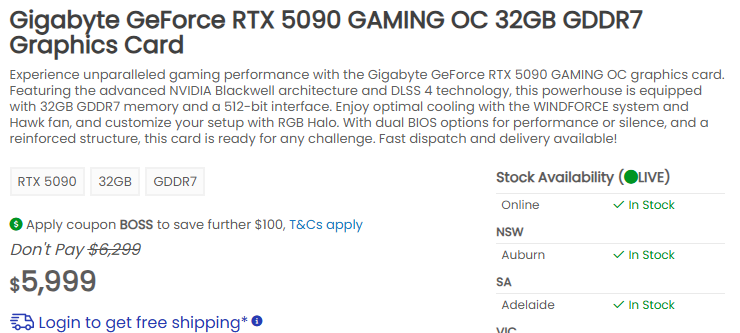

Riktiga priser

Lite dyra…

Och de riktiga RTX 5090-priserna är 50% högre än förväntat. Titta på detta!

Detta är den 15/05/2025

För att utforska LLM-benchmarkar, VRAM-krav och prestandaoptimering på olika GPU:er och körningar, kontrollera vår LLM-prestanda: Benchmarkar, halsar och optimering hub.