Self-Hosting Cognee: Uji Kinerja LLM

Menguji Cognee dengan LLM lokal - hasil nyata

Cognee adalah kerangka kerja Python untuk membangun grafik pengetahuan dari dokumen menggunakan LLM. Tapi apakah itu bekerja dengan model yang dihosting sendiri?

Menguji Cognee dengan LLM lokal - hasil nyata

Cognee adalah kerangka kerja Python untuk membangun grafik pengetahuan dari dokumen menggunakan LLM. Tapi apakah itu bekerja dengan model yang dihosting sendiri?

Pikiran tentang LLM untuk Cognee yang dihosting sendiri

Memilih LLM Terbaik untuk Cognee memerlukan keseimbangan antara kualitas pembuatan graf, tingkat halusinasi, dan pembatasan perangkat keras. Cognee unggul dengan model besar berhalusinasi rendah (32B+) melalui Ollama tetapi pilihan ukuran sedang juga cocok untuk konfigurasi yang lebih ringan.

Bangun agen pencarian AI dengan Python dan Ollama

Perpustakaan Python Ollama sekarang mencakup kemampuan pencarian web OLlama web search. Dengan hanya beberapa baris kode, Anda dapat memperkuat LLM lokal Anda dengan informasi real-time dari web, mengurangi halusinasi dan meningkatkan akurasi.

Pilih vector DB yang tepat untuk tumpukan RAG Anda

Memilih penyimpanan vektor yang tepat dapat menentukan keberhasilan, biaya, dan skalabilitas aplikasi RAG Anda. Perbandingan menyeluruh ini mencakup opsi paling populer pada 2024-2025.

Bangun agen pencarian AI dengan Go dan Ollama

API Pencarian Web Ollama memungkinkan Anda memperluas LLM lokal dengan informasi web secara real-time. Panduan ini menunjukkan cara mengimplementasikan kemampuan pencarian web dalam Go, dari panggilan API sederhana hingga agen pencarian berfitur lengkap.

Masterkan implementasi LLM lokal dengan 12+ alat yang dibandingkan

Penyimpanan lokal LLM telah semakin populer seiring dengan kebutuhan pengembang dan organisasi akan privasi yang lebih baik, latensi yang lebih rendah, dan kontrol yang lebih besar terhadap infrastruktur AI mereka.

Buatkan AI perusahaan di perangkat keras berbasis anggaran dengan model terbuka

Demokratisasi AI sudah tiba. Dengan LLM open-source seperti Llama 3, Mixtral, dan Qwen kini bersaing dengan model proprietary, tim dapat membangun infrastruktur AI yang kuat menggunakan perangkat keras konsumen - mengurangi biaya sambil mempertahankan kontrol penuh atas privasi data dan penggunaan.

LongRAG, Self-RAG, GraphRAG - Teknik generasi berikutnya

Retrieval-Augmented Generation (RAG) telah berkembang jauh melampaui pencarian kesamaan vektor sederhana. LongRAG, Self-RAG, dan GraphRAG mewakili ujung tombak dari kemampuan-kemampuan ini.

Potong biaya LLM sebesar 80% dengan optimisasi token yang cerdas

Optimasi token adalah keterampilan kritis yang membedakan aplikasi LLM yang hemat biaya dari eksperimen yang menghabiskan anggaran.

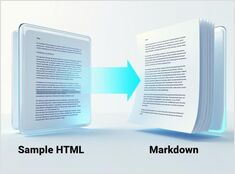

Python untuk mengonversi HTML menjadi Markdown yang bersih dan siap digunakan oleh LLM

Menkonversi HTML ke Markdown adalah tugas dasar dalam alur kerja pengembangan modern, terutama ketika mempersiapkan konten web untuk Large Language Models (LLMs), sistem dokumentasi, atau generator situs statis seperti Hugo.

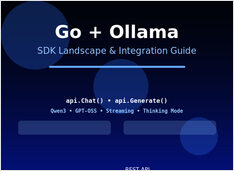

Integrasi Ollama dengan Go: Panduan SDK, contoh, dan praktik terbaik untuk produksi.

Panduan ini memberikan gambaran menyeluruh tentang SDK Go untuk Ollama yang tersedia dan membandingkan set fitur mereka.

Membandingkan kecepatan, parameter, dan kinerja dari dua model ini

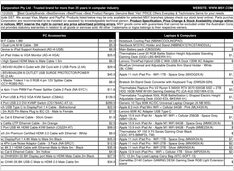

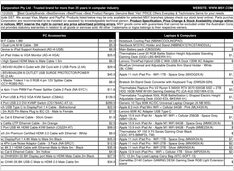

Berikut adalah perbandingan antara Qwen3:30b dan GPT-OSS:20b dengan fokus pada pemenuhan instruksi dan parameter kinerja, spesifikasi, serta kecepatan:

+ Contoh Spesifik Menggunakan LLM Berpikir

Dalam posting ini, kita akan menjelajahi dua cara untuk menghubungkan aplikasi Python Anda ke Ollama: 1. Melalui HTTP REST API; 2. Melalui perpustakaan Ollama Python resmi.

API yang sedikit berbeda memerlukan pendekatan khusus.

Berikut adalah perbandingan dukungan sampingan untuk output terstruktur (mendapatkan JSON yang andal) di berbagai penyedia LLM populer, beserta contoh Python minimal

Beberapa cara untuk mendapatkan output terstruktur dari Ollama

Model Bahasa Besar (LLMs) sangat kuat, tetapi dalam produksi kita jarang ingin paragraf bebas. Sebaliknya, kita ingin data yang dapat diprediksi: atribut, fakta, atau objek terstruktur yang dapat Anda masukkan ke dalam aplikasi. Itu adalah Keluaran Terstruktur LLM.

Menerapkan RAG? Berikut beberapa potongan kode Go - 2...

Karena Ollama standar tidak memiliki API rerank langsung, Anda perlu menerapkan reranking menggunakan Qwen3 Reranker dalam GO dengan menghasilkan embedding untuk pasangan query-dokumen dan memberi skor mereka.