اختبارات أداء نموذج لغوي كبير لـ Cognee المضيف الذاتي

اختبار Cognee مع نماذج LLM المحلية - نتائج حقيقية

Cognee هي إطار عمل بلغة Python لبناء مخططات المعرفة من الوثائق باستخدام LLMs. لكن هل يعمل مع النماذج المضيفة محليًا؟

اختبار Cognee مع نماذج LLM المحلية - نتائج حقيقية

Cognee هي إطار عمل بلغة Python لبناء مخططات المعرفة من الوثائق باستخدام LLMs. لكن هل يعمل مع النماذج المضيفة محليًا؟

آراء حول نماذج LLM للنسخة المثبتة محليًا من Cognee

اختيار أفضل نموذج LLM لـ Cognee يتطلب موازنة جودة بناء الرسوم البيانية، معدلات التخيل، والقيود المادية. Cognee تتفوق مع النماذج الكبيرة ذات التخيل المنخفض (32B+) عبر Ollama ولكن الخيارات المتوسطة تعمل للاعدادات الخفيفة.

أنشئ وكلاء بحث ذكاء اصطناعي باستخدام بايثون وOllama

أصبحت مكتبة Ollama لـ Python تحتوي الآن على إمكانيات بحث Ollama على الويب الأصلية. باستخدام بضع سطور من الكود فقط، يمكنك تعزيز نماذج LLM المحلية ببيانات حقيقية من الإنترنت، مما يقلل من الهلوسات ويزيد من الدقة.

اختر قاعدة بيانات المتجهات المناسبة لstack RAG الخاص بك

اختيار خزن المتجهات المناسب يمكن أن يحدد نجاح أو فشل تطبيق RAG من حيث الأداء، التكلفة، والقدرة على التوسع. تغطي هذه المقارنة الشاملة خيارات أكثر شيوعًا في عامي 2024-2025.

أنشئ وكلاء بحث ذكاء اصطناعي باستخدام Go وOllama

واجهة بحث الويب في Ollama تتيح لك تحسين نماذج LLM المحلية بمعلومات الويب في الوقت الفعلي. توضح هذه المقالة لك كيفية تنفيذ قدرات البحث عبر الويب في Go، من مكالمات API بسيطة إلى وكلاء البحث المتكاملين.

تزيد أسعار الذاكرة العشوائية (RAM) بنسبة 163 إلى 619% مع تزايد الطلب الناتج عن الذكاء الاصطناعي وتراجع المعروض

تواجه سوق الذاكرة تقلبات في الأسعار غير مسبوقة في أواخر عام 2025، مع ارتفاع أسعار الذاكرة العشوائية بشكل كبير في جميع الفئات.

استخدم 12+ أداة لمقارنة نشر نماذج LLM المحلية بشكل محترف

النشر المحلي للنماذج الكبيرة أصبح أكثر شيوعًا مع تطلع المطورين والمنظمات إلى خصوصية محسنة وتقليل التأخير وزيادة السيطرة على بنية تحتية الذكاء الاصطناعي الخاصة بهم.

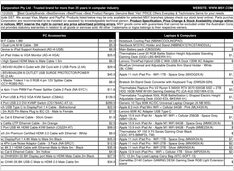

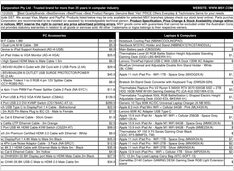

أسعار وحدات معالجة الرسومات المخصصة للذكاء الاصطناعي - RTX 5080 و RTX 5090

لنقارن الأسعار بين أفضل بطاقات الجرافيكس من نوع GPU للمستهلكين، والتي مناسبة بشكل خاص للنماذج العصبية الكبيرة (LLMs) بشكل عام للذكاء الاصطناعي. بالتحديد أنا أبحث عن أسعار RTX-5080 و RTX-5090.

قم بتشغيل الذكاء الاصطناعي المؤسسي على معدات ميسرة بأسعار معقولة باستخدام نماذج مفتوحة المصدر

الديموقراطية في الذكاء الاصطناعي هنا. مع نماذج LLM المفتوحة المصدر مثل Llama 3، وMixtral، وQwen الآن تنافس النماذج الخاصة، يمكن للمجموعات بناء بنية تحتية قوية للذكاء الاصطناعي باستخدام معدات الاستهلاك - مما يقلل التكاليف مع الحفاظ على التحكم الكامل في خصوصية البيانات والنشر.

قم بتكوين مراقبة البنية التحتية القوية باستخدام بروميثيوس

Prometheus أصبح المعيار الافتراضي لمراقبة التطبيقات والبنية التحتية المستندة إلى السحابة، حيث يوفر جمع البيانات، والسؤال عنها، والتكامل مع أدوات الرسم البياني.

استيعاب إعداد Grafana للمراقبة والتصور

جرافانا هي منصة مفتوحة المصدر الرائدة لمراقبة وقابلية الملاحظة، والتي تحول المعايير والسجلات والمسارات إلى رؤى قابلة للتنفيذ من خلال تصورات مذهلة.

نشر تطبيقات مُحَفَّظة مع التوسع المُرَتَّب والبيانات المستمرة

Kubernetes StatefulSets هي الحل المثالي لإدارة تطبيقات تتطلب هويات مستقرة، تخزين دائم، ونمط توزيع منظم—وهي ضرورية للقواعد البيانات، الأنظمة الموزعة، وطبقات التخزين المؤقت.

تسريع FLUX.1-dev باستخدام كمّ量化 GGUF

FLUX.1-dev هو نموذج قوي لتحويل النص إلى صورة ينتج نتائج مذهلة، ولكن متطلباته من الذاكرة البالغة 24 جيجابايت أو أكثر تجعله تحديًا لتشغيله على العديد من الأنظمة. تكميم GGUF لـ FLUX.1-dev يقدم حلًا، حيث يقلل من استخدام الذاكرة بنسبة تصل إلى 50% مع الحفاظ على جودة الصورة الممتازة.

กำหนด حجم السياق في Docker Model Runner باستخدام حلول بديلة

تهيئة أحجام السياق في Docker Model Runner أكثر تعقيدًا مما ينبغي أن يكون.

نموذج الذكاء الاصطناعي لتعزيز الصور باستخدام تعليمات النص

لقد أطلقت مختبرات Black Forest FLUX.1-Kontext-dev، نموذج ذكاء اصطناعي متقدم لتحويل الصور من خلال استخدام تعليمات نصية.

تفعيل تسريع وحدة معالجة الرسومات (GPU) لتشغيل نماذج Docker مع دعم NVIDIA CUDA

Docker Model Runner هو الأداة الرسمية لـ Docker لتشغيل النماذج الذكية الاصطناعية محليًا، ولكن تمكين تسريع GPU من NVidia في Docker Model Runner يتطلب تكوينًا خاصًا.