اختبارات أداء نموذج لغوي كبير لـ Cognee المضيف الذاتي

اختبار Cognee مع نماذج LLM المحلية - نتائج حقيقية

Cognee هي إطار عمل بلغة Python لبناء مخططات المعرفة من الوثائق باستخدام LLMs. لكن هل يعمل مع النماذج المضيفة محليًا؟

اختبار Cognee مع نماذج LLM المحلية - نتائج حقيقية

Cognee هي إطار عمل بلغة Python لبناء مخططات المعرفة من الوثائق باستخدام LLMs. لكن هل يعمل مع النماذج المضيفة محليًا؟

مخرجات نموذج LLM الآمن من الناحية النوعية باستخدام BAML والدروسية

عند العمل مع نماذج لغات كبيرة في الإنتاج، فإن الحصول على مخرجات منظمة وآمنة من حيث النوع أمر حيوي. تتناول إطارات شائعة مثل BAML و Instructor نهجًا مختلفًا لحل هذه المشكلة.

آراء حول نماذج LLM للنسخة المثبتة محليًا من Cognee

اختيار أفضل نموذج LLM لـ Cognee يتطلب موازنة جودة بناء الرسوم البيانية، معدلات التخيل، والقيود المادية. Cognee تتفوق مع النماذج الكبيرة ذات التخيل المنخفض (32B+) عبر Ollama ولكن الخيارات المتوسطة تعمل للاعدادات الخفيفة.

أنشئ وكلاء بحث ذكاء اصطناعي باستخدام بايثون وOllama

أصبحت مكتبة Ollama لـ Python تحتوي الآن على إمكانيات بحث Ollama على الويب الأصلية. باستخدام بضع سطور من الكود فقط، يمكنك تعزيز نماذج LLM المحلية ببيانات حقيقية من الإنترنت، مما يقلل من الهلوسات ويزيد من الدقة.

أنشئ وكلاء بحث ذكاء اصطناعي باستخدام Go وOllama

واجهة بحث الويب في Ollama تتيح لك تحسين نماذج LLM المحلية بمعلومات الويب في الوقت الفعلي. توضح هذه المقالة لك كيفية تنفيذ قدرات البحث عبر الويب في Go، من مكالمات API بسيطة إلى وكلاء البحث المتكاملين.

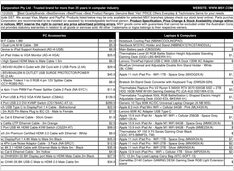

استخدم 12+ أداة لمقارنة نشر نماذج LLM المحلية بشكل محترف

النشر المحلي للنماذج الكبيرة أصبح أكثر شيوعًا مع تطلع المطورين والمنظمات إلى خصوصية محسنة وتقليل التأخير وزيادة السيطرة على بنية تحتية الذكاء الاصطناعي الخاصة بهم.

قم بتشغيل الذكاء الاصطناعي المؤسسي على معدات ميسرة بأسعار معقولة باستخدام نماذج مفتوحة المصدر

الديموقراطية في الذكاء الاصطناعي هنا. مع نماذج LLM المفتوحة المصدر مثل Llama 3، وMixtral، وQwen الآن تنافس النماذج الخاصة، يمكن للمجموعات بناء بنية تحتية قوية للذكاء الاصطناعي باستخدام معدات الاستهلاك - مما يقلل التكاليف مع الحفاظ على التحكم الكامل في خصوصية البيانات والنشر.

نتائج اختبار GPT-OSS 120b على ثلاث منصات ذكاء اصطناعي

قمت بتحليل بعض الاختبارات المثيرة للاهتمام حول أداء نموذج GPT-OSS 120b أثناء تشغيله على Ollama عبر ثلاث منصات مختلفة: NVIDIA DGX Spark، وMac Studio، وRTX 4080. يبلغ حجم نموذج GPT-OSS 120b من مكتبة Ollama 65 جيجابايت، مما يعني أنه لا يمكن أن يناسب الـ 16 جيجابايت من ذاكرة الفيديو (VRAM) الخاصة بـ RTX 4080 (أو النسخة الأحدث RTX 5080).

قارن بين Docker Model Runner و Ollama للذكاء الاصطناعي المحلي

تشغيل نماذج لغة كبيرة (LLMs) محليًا أصبح أكثر شيوعًا من أجل الخصوصية، والتحكم في التكاليف، والقدرات خارج الإنترنت. تغير المشهد بشكل كبير في أبريل 2025 عندما أدخلت Docker Docker Model Runner (DMR)، حلها الرسمي لنشر النماذج الذكية الاصطناعية.

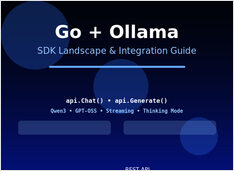

دمج Ollama مع Go: دليل SDK، أمثلة، وممارسات إنتاجية مثالية.

هذا الدليل يقدم لمحة شاملة عن مكتبات Go SDK المتاحة لـ Ollama ويقارن مجموعات ميزاتها.

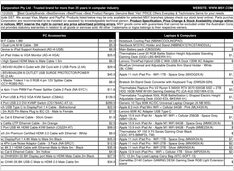

مقارنة السرعة والparameters والأداء بين هذين النموذجين

هنا مقارنة بين Qwen3:30b و GPT-OSS:20b

متركزة على اتباع التعليمات والمؤشرات الأداء، المواصفات والسرعة:

أمثلة محددة باستخدام نماذج التفكير الكبيرة

في هذا المقال، سنستكشف طريقتين لربط تطبيقك Python مع Ollama: 1. عبر HTTP REST API; 2. عبر المكتبة الرسمية لـ Ollama لـ Python.

ليس جيدًا جدًا.

نماذج GPT-OSS الخاصة بـ Ollama تعاني من مشاكل متكررة في التعامل مع الإخراج المهيكل، خاصة عند استخدامها مع الإطارات مثل LangChain، OpenAI SDK، vllm وغيرها.

بضع طرق للحصول على إخراج منظم من Ollama

النماذج الكبيرة للغة (LLMs) قوية، ولكن في الإنتاج نادراً ما نريد فقرات حرة. بدلاً من ذلك، نريد بيانات قابلة للتنبؤ: خصائص، حقائق، أو كائنات منظمة يمكنك إدخالها في تطبيق. هذا هو مخرجات LLM المنظمة.

اختباري الخاص لجدولة نموذج ollama ````

هنا أقارن كمية الـVRAM التي تخصصها الإصدار الجديد من Ollama للموديل مع الإصدار السابق من Ollama. الإصدار الجديد أسوأ.

رأيي في الحالة الحالية لتطوير أوالما

Ollama أصبح من بين الأدوات الأكثر شعبية بسرعة لتشغيل نماذج LLM محليًا. بواجهة سطر الأوامر البسيطة وإدارة النماذج المبسطة، أصبحت خيارًا مفضلاً للمطورين الذين يريدون العمل مع نماذج الذكاء الاصطناعي خارج السحابة. لكن كما هو الحال مع منصات واعدة كثيرة، هناك مؤشرات مبكرة على Enshittification: